Histoire du trading algorithmique

L'histoire du trading algorithmique montre qu'en 2013, près de 70 % des actions américaines étaient déjà négociées à l'aide de programmes automatisés, selon plusieurs analystes. Depuis, cette proportion n'a cessé d'augmenter, confirmant la place centrale qu'occupent aujourd'hui les algorithmes dans le fonctionnement des marchés financiers.

Cette domination ne s'est toutefois pas construite du jour au lendemain. Pour comprendre l'importance actuelle du trading algorithmique, il faut revenir à ses origines. Son développement commence avec l'essor d'Internet à la fin des années 1980 et au début des années 1990. Mais le véritable tournant intervient en 1998, lorsque la Securities and Exchange Commission (SEC) américaine autorise les échanges électroniques, ouvrant la voie à l'essor du trading informatisé et, plus tard, du trading à haute fréquence.

Qu'est-ce que le trading algorithmique ?

Le trading algorithmique désigne une méthode d'exécution des ordres basée sur des programmes informatiques capables de suivre des règles précises. Ces algorithmes intègrent différents paramètres - notamment le moment d'exécution, le prix et le volume - afin de déterminer automatiquement quand acheter ou vendre un actif. En pratique, il s'agit de transformer une stratégie de trading en code informatique, qui exécute les décisions de manière autonome.

Souvent appelé trading automatisé ou algo trading, ce type d'approche exploite la vitesse de calcul et la disponibilité permanente des ordinateurs, bien supérieures à celles d'un opérateur humain. Des logiciels spécialisés permettent ainsi de déployer automatiquement des stratégies basées sur des modèles mathématiques. Certaines cherchent à suivre les tendances du marché, tandis que d'autres reposent sur des logiques de retour à la moyenne.

Dans d'autres cas, ces systèmes sont utilisés pour des stratégies d'arbitrage ou de spread betting. Une grande partie d'entre elles relève du trading à haute fréquence (HFT), caractérisé par un très grand nombre d'ordres et d'exécutions. Les algorithmes analysent alors en temps réel des flux d'informations électroniques et prennent des décisions en quelques fractions de seconde, souvent bien avant qu'un trader humain puisse réagir.

Depuis le début des années 2000, l'utilisation de ces technologies s'est largement étendue, aussi bien chez les investisseurs institutionnels que chez certains traders particuliers. Une étude publiée en 2019 estimait ainsi qu'environ 92 % des transactions sur le marché du Forex étaient réalisées par des algorithmes plutôt que directement par des humains. Aujourd'hui, la plupart des grandes banques d'investissement, des fonds de pension, des fonds communs de placement et des hedge funds s'appuient sur ces systèmes pour exécuter leurs ordres les plus importants de manière plus efficace et discrète.

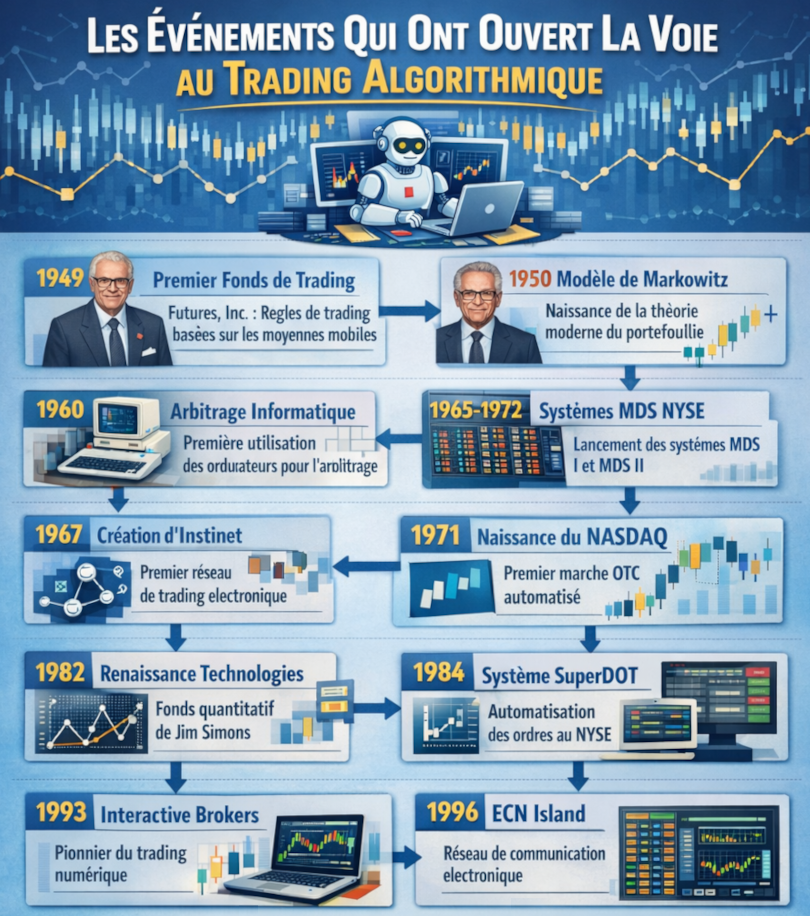

Les événements qui ont ouvert la voie au trading algorithmique

Avant que le trading algorithmique ne devienne populaire, de nombreux événements se sont produits sur les marchés financiers pour lui ouvrir la voie. Voici quelques-uns des plus importants :

Le premier fonds basé sur des règles de trading a été lancé en 1949 : un trader américain, Richard Donchian, a lancé Futures, Inc., un fonds public spécialisé dans les matières premières et négociant sur les marchés à terme. Ce fonds a été le premier à utiliser un ensemble de règles prédéterminées pour générer des signaux d'achat et de vente réels. Il utilisait un système mathématique basé sur les moyennes mobiles des prix du marché des matières premières. Comme il n'y avait pas encore d'Internet pour le soutenir, les développeurs devaient tracer manuellement les graphiques des marchés à partir des données fournies par les téléscripteurs. Avec son système basé sur des règles, cela peut être considéré comme la première tentative d'automatisation du trading.

Harry Max Markowitz a introduit le modèle Markowitz en 1950 : Markowitz a introduit la finance computationnelle pour traiter la question de la sélection de portefeuille, qui est devenue la base de la théorie moderne du portefeuille ou TMP, présentée dans le Journal of Finance en 1952. Markowitz est considéré comme le père de l'analyse quantitative.

La première opération d'arbitrage utilisant des ordinateurs a eu lieu en 1960 : les gestionnaires de fonds spéculatifs Ed Thorp et Michael Goodkin se sont associés à Harry Markowitz pour créer un système utilisant des ordinateurs pour le trading d'arbitrage. Avec l'introduction des ordinateurs personnels à la fin des années 1970 et au début des années 1980, de nombreuses applications de finance computationnelle ont été développées et les méthodes de traitement du signal, telles que l'analyse des séries chronologiques et l'optimisation, sont devenues courantes.

Les systèmes MDS I et MDS-II de la Bourse de New York ont été lancés en 1965 : le système de déclaration des transactions de la Bourse de New York, le Market Data System I (MDSI), a été lancé afin de fournir des cotations automatisées. Le succès du MDS I a conduit au développement du MDS-II, qui était trois fois plus performant que le MDSI. Le MDSII est devenu pleinement opérationnel en juillet 1972.

La création du système de négociation Instinet en 1967 : Jerome M. Pustilnik et Herbert R. Behrens ont créé en 1967 Instinet, le plus ancien réseau de communication électronique de Wall Street. L'introduction d'Instinet a permis aux grands investisseurs institutionnels de négocier directement entre eux des titres cotés sur le marché hors cote ou sur le marché libre dans un cadre électronique, ce qui a fait d'Instinet un concurrent de taille pour le NYSE.

La création du Nasdaq : le Nasdaq a été créé en 1971 afin d'offrir des services de trading de gré à gré (OTC) entièrement automatisés. Proposant initialement uniquement des cotations, le Nasdaq a ensuite commencé à offrir des services de trading électronique, devenant ainsi le premier à proposer des services de négociation en ligne.

Le lancement de l'Intermarket Trading System en 1978 : le Nasdaq Intermarket Trading System (ITS) a profondément bouleversé le secteur. Ce réseau, géré par la Securities Industry Automation Corporation (SIAC), est un réseau électronique qui reliait les salles de marché de différentes bourses et permettait une communication et des transactions en temps réel entre elles. Grâce à ce réseau, tout courtier présent dans la salle d'une bourse participante pouvait réagir aux variations de prix en temps réel et passer un ordre sous la coordination de l'ITS.

Le lancement de Renaissance Technologies en 1982 : Renaissance Technologies est un fonds quantitatif fondé par Jim Simons. Le fonds exploitait des modèles mathématiques pour prédire les fluctuations des prix des instruments financiers, en utilisant son programme algorithmique de trading « boîte noire » de 10 milliards de dollars. Il utilisait uniquement l'analyse quantitative pour sélectionner les transactions à effectuer.

Le lancement du flux d'ordres informatisé du NYSE en 1984 : bien que l'informatisation du flux d'ordres ait commencé dans les années 1970, le tournant décisif a eu lieu en 1984, lorsque la Bourse de New York a lancé le système « designated order turnaround » (DOT), qui est devenu par la suite le SuperDOT. Le DoT acheminait les ordres par voie électronique vers le poste de négociation approprié, qui les exécutait manuellement. Le SuperDOT facilitait la transmission des ordres au marché depuis une société membre directement vers la salle des marchés du NYSE pour exécution, de sorte qu'une fois l'ordre exécuté en salle, la société recevait une confirmation d'ordre. Le système SuperDOT a marqué une étape importante dans l'exécution des transactions sur actions, tant en termes de rapidité que de volume, car il permettait d'acheminer électroniquement des ordres allant jusqu'à 2 000 actions vers un spécialiste.

Interactive Brokers a été fondée en 1993 : Fondée par Thomas Peterffy en 1993, Interactive Brokers a été la pionnière du trading numérique. La société a popularisé la technologie développée par Timber Hill (le premier ordinateur portable destiné au trading) pour les services de réseau électronique et d'exécution des transactions pour les clients. Avant de fonder Interactive Brokers, Thomas Peterffy avait créé en 1987 le premier système de trading algorithmique entièrement automatisé, qui utilisait un ordinateur IBM capable d'extraire des données d'un terminal Nasdaq connecté et d'effectuer des transactions de manière entièrement automatisée.

Le lancement d'Island, un ECN, en 1996 : également connu sous le nom d'Island à l'époque, le réseau de communication électronique (ECN) a été lancé en 1996. Le réseau permettait aux traders abonnés de recevoir des informations sur les actions par le biais d'un flux électronique. Il fournit en permanence des informations en temps réel sur les prix d'exécution et les volumes

Les premiers développements

Un tournant majeur intervient en 1998 lorsque la Securities and Exchange Commission (SEC) américaine autorise les systèmes de trading alternatifs. Cette décision ouvre la voie à l'essor des plateformes électroniques et marque le début d'une transformation profonde de la structure des marchés financiers. En permettant l'apparition de nouvelles infrastructures de négociation, elle crée les conditions nécessaires au développement du trading informatisé, puis du trading à haute fréquence.

Les nouvelles règles adoptées par la SEC offrent alors aux systèmes de trading alternatifs la possibilité de s'enregistrer soit comme courtiers-négociants, soit comme bourses nationales de valeurs mobilières. Selon leur activité et leur volume d'échanges, ils doivent également se conformer aux exigences prévues par la Regulation ATS. Ce cadre réglementaire renforce la crédibilité et la transparence de ces plateformes émergentes et contribue largement à l'expansion rapide du trading algorithmique.

Un autre événement clé favorise l'adoption de ces technologies : l'achèvement du processus de décimalisation aux États-Unis en 2001. Cette réforme fait passer la taille minimale du tick de 1/16 de dollar (0,0625 $) à 0,01 dollar par action. Ce changement modifie profondément la structure du marché en permettant des écarts plus faibles entre les prix acheteurs et vendeurs.

Initialement introduite pour aligner les marchés américains sur les standards internationaux, la décimalisation apporte aussi plusieurs avantages aux investisseurs. Les variations de prix deviennent plus lisibles et les réactions du marché plus rapides, tandis que les spreads se resserrent grâce à des ajustements de prix plus fins.

La transition débute le 28 août 2000 et s'achève le 9 avril 2001. Entre-temps, le 29 janvier 2001, le New York Stock Exchange (NYSE) et l'American Stock Exchange adoptent officiellement le système décimal. Depuis lors, les cotations boursières américaines sont exprimées sous forme décimale plutôt que fractionnaire.

Période d'affinement et de croissance

Après l'ouverture du marché aux systèmes alternatifs de négociation, d'autres réformes viennent progressivement moderniser l'infrastructure des marchés électroniques. En 2005, la SEC introduit ainsi le Regulation National Market System (Reg NMS), qui entrera pleinement en vigueur en 2007.

Le Reg NMS regroupe plusieurs mesures destinées à renforcer le fonctionnement du système national de marché pour les actions. Parmi elles figure la règle de protection des ordres, qui impose aux places boursières de transmettre leurs données en temps réel à une entité centralisée et oblige courtiers et plateformes à exécuter les transactions au meilleur prix disponible. Cette règle, souvent associée au principe de « trade through », modifie profondément les pratiques de négociation et crée un environnement particulièrement favorable aux stratégies algorithmiques, notamment celles du trading à haute fréquence.

L'évolution technologique joue également un rôle déterminant. En 2008, la société AQR Capital Management développe Pandas, une bibliothèque logicielle dédiée à la manipulation et à l'analyse de données dans le langage de programmation Python. Cet outil devient rapidement incontournable pour les chercheurs quantitatifs et les développeurs qui travaillent sur l'analyse rapide de données financières.

Dans le même temps, les infrastructures de communication connaissent elles aussi des progrès majeurs. En août 2010, la société Spread Networks met en service une liaison de fibre optique ultrarapide entre les zones métropolitaines de New York et de Chicago. Cette route, longue d'environ 825 miles, permet de transmettre les données en seulement 13,3 millisecondes. Une telle réduction de la latence représente un avantage considérable pour les acteurs du trading algorithmique et contribue à accélérer la croissance de l'écosystème du trading à haute fréquence (HFT).

Le boom

Le trading algorithmique connaît une expansion spectaculaire à la fin des années 2000. Au début de cette décennie, ces systèmes représentaient encore moins de 10 % des ordres sur actions. Mais leur progression est fulgurante : à la fin de 2009, les stratégies automatisées comptent déjà pour environ 70 % des échanges sur les marchés boursiers américains. Selon le New York Stock Exchange (NYSE), le volume des transactions réalisées par des algorithmes a augmenté de 164 % entre 2005 et 2009.

Cette croissance s'accompagne d'une accélération spectaculaire de la vitesse d'exécution. Au début des années 2000, une opération de trading à haute fréquence pouvait encore prendre plusieurs secondes. Moins d'une décennie plus tard, le temps d'exécution se mesure en millisecondes, puis en microsecondes, avant d'atteindre quelques nanosecondes vers 2012.

Cette combinaison de volumes élevés et de vitesses extrêmes comporte toutefois des risques. Elle peut favoriser des mouvements de marché extrêmement rapides, connus sous le nom de « flash crashes ». L'un des plus célèbres survient en mai 2010, lorsqu'une vente automatisée d'environ 4,1 milliards de dollars déclenche une chute brutale du marché. En quelques minutes, près d'un trillion de dollars de capitalisation boursière disparaît temporairement. L'indice Dow Jones perd alors environ 1 000 points sur la journée, dont 600 points en seulement cinq minutes, avant de se redresser rapidement.

À la suite de cet épisode, la Securities and Exchange Commission (SEC) met en place des coupe-circuits destinés à suspendre temporairement les échanges lorsque la volatilité devient excessive, afin d'éviter les spirales de ventes automatisées.

Les autorités américaines poursuivent ensuite leurs efforts pour encadrer ces pratiques. En 2015, la Commodity Futures Trading Commission (CFTC) approuve de nouvelles règles visant à renforcer la supervision du trading automatisé sur les Designated Contract Markets (DCM). L'objectif est de réduire les risques potentiels liés à ces technologies en imposant notamment des contrôles sur le nombre de messages d'ordres, la taille maximale des ordres et les procédures de gestion des risques. Ces règles visent également à améliorer la transparence en définissant des normes pour le développement, les tests et la surveillance des systèmes de trading automatisés.

Parallèlement aux évolutions réglementaires, les innovations technologiques continuent de repousser les limites de la vitesse. En 2011, la société technologique londonienne Fixnetix lance une technologie de nano-trading reposant sur une puce électronique baptisée iX-eCute. Basée sur une architecture FPGA (Field-Programmable Gate Array), cette puce est capable d'exécuter des transactions en quelques dizaines de nanosecondes. Elle peut effectuer plus de 20 contrôles préalables de risque en moins de 100 nanosecondes, ce qui permet aux institutions financières d'exécuter leurs ordres avec une latence extrêmement faible. Ces infrastructures combinent systèmes algorithmiques et réseaux ultra-rapides reliant les institutions aux bourses et aux réseaux de communication électroniques (ECN).

Un autre élément favorise l'essor du trading algorithmique : l'ouverture de ces technologies à une communauté plus large de développeurs. En 2011, John Fawcett et Jean Bredeche fondent ainsi Quantopian, une plateforme qui met à disposition des données financières et des outils open source, notamment en Python, permettant de concevoir et de tester gratuitement des stratégies automatisées.

L'objectif est double : permettre aux développeurs de créer leurs propres algorithmes et identifier les stratégies les plus performantes pour les proposer ensuite à des investisseurs institutionnels. Pour cela, la plateforme organise des concours appelés « Quantopian Open », ouverts à tous, quel que soit le niveau d'études ou l'expérience professionnelle. Les algorithmes les plus performants peuvent alors être utilisés pour gérer des capitaux institutionnels, les créateurs recevant une rémunération sous forme de redevances ou de commissions.

Malgré son succès initial et l'intérêt de nombreux investisseurs, Quantopian rencontre finalement des difficultés financières et ferme ses portes en 2020, marquant la fin d'une expérience emblématique dans la démocratisation du trading algorithmique.

Analyse des réseaux sociaux et intégration dans le trading algorithmique

Au début des années 2010, une nouvelle source d'information commence à attirer l'attention des acteurs du trading algorithmique : les réseaux sociaux. En septembre 2012, la start-up new-yorkaise Dataminr lance ainsi un service innovant, financé par un investissement d'environ 30 millions de dollars, capable de transformer les conversations en ligne en signaux exploitables pour les marchés financiers. L'objectif est ambitieux : détecter des informations économiques émergentes et les transmettre aux clients parfois jusqu'à 54 minutes avant les médias traditionnels.

La plateforme s'appuie sur des algorithmes capables d'identifier ce qu'elle appelle des « micro-tendances », c'est-à-dire de faibles signaux provenant des discussions en ligne qui peuvent révéler un événement en cours ou anticiper un changement de sentiment sur les marchés. En repérant ces signaux précoces, les investisseurs peuvent obtenir un avantage informationnel et réagir plus rapidement.

Les informations économiques ne représentent toutefois qu'une partie du potentiel des réseaux sociaux. D'autres types de signaux peuvent également influencer les marchés : les réactions des consommateurs face à un produit, les changements de ton dans certaines communautés spécialisées, ou encore la manière dont l'attention du public augmente ou décline autour d'un sujet donné.

Plusieurs entreprises technologiques développent alors des outils d'intelligence artificielle capables d'analyser les modèles linguistiques et la propagation de l'information parmi les centaines de millions de messages publiés chaque jour sur Twitter. Ces systèmes réalisent des analyses en temps réel afin d'identifier des signaux susceptibles d'avoir un impact sur les marchés.

Dans un premier temps, les autorités de régulation se montrent toutefois prudentes face à l'influence immédiate que peuvent avoir ces plateformes sur les cours boursiers. Le 2 avril 2013, la Securities and Exchange Commission (SEC) et la Commodity Futures Trading Commission (CFTC) imposent certaines restrictions concernant la communication des entreprises cotées via les réseaux sociaux.

Malgré ces réserves initiales, l'utilisation de ces canaux d'information continue de progresser. Les outils professionnels s'adaptent rapidement à cette nouvelle réalité. Ainsi, Bloomberg intègre les flux de Twitter dans ses Bloomberg Terminals grâce à la fonctionnalité Bloomberg Social Velocity, qui détecte les pics inhabituels de conversations autour d'une entreprise ou d'un événement.

Un épisode marquant illustre l'influence potentielle des réseaux sociaux sur les marchés. Le 23 avril 2013, un faux message publié sur le compte Twitter de l'Associated Press, piraté pour l'occasion, annonce que deux explosions ont frappé la Maison Blanche. En quelques minutes, la rumeur provoque une vague de panique à Wall Street : l'indice Dow Jones chute d'environ 1 %, soit 143 points, passant de 14 699 à 14 555 en seulement trois minutes, avant de se redresser une fois la fausse information démentie.

La situation actuelle

Aujourd'hui, le trading algorithmique a encore évolué avec l'intégration de technologies d'intelligence artificielle et d'apprentissage automatique. Ces outils permettent d'analyser des volumes de données toujours plus importants et d'améliorer la précision des stratégies automatisées.

Malgré ces avancées, un facteur reste déterminant : la vitesse. Pour réduire au maximum la latence - le temps nécessaire à l'exécution d'un ordre - les institutions financières et les sociétés de trading pour compte propre cherchent à installer leurs serveurs informatiques au plus près des infrastructures des marchés. Cette pratique, appelée co-location, consiste par exemple à placer les ordinateurs dans les mêmes centres de données que les serveurs des bourses, notamment à New York, ou à proximité des principales sources d'information susceptibles d'influencer les marchés, comme certaines agences gouvernementales à Washington.

Grâce à cette proximité physique, ces acteurs peuvent recevoir les informations et accéder aux prix du marché quelques fractions de seconde avant les autres investisseurs, ce qui représente un avantage considérable dans un environnement où les décisions se prennent en microsecondes.

Compte tenu de l'importance croissante du trading à haute fréquence (HFT) dans le fonctionnement des marchés modernes, les autorités de régulation surveillent attentivement ces activités. Leur objectif est de préserver l'efficacité et la stabilité du système financier tout en s'adaptant à l'évolution rapide des technologies utilisées par les acteurs du marché.

FAQ

Quand le trading algorithmique a-t-il fait son apparition ?

Le trading algorithmique est apparu à la fin des années 1980 et au début des années 1990 avec l'avènement d'Internet. Il s'est popularisé en 1998 lorsque la Securities and Exchange Commission (SEC) des États-Unis a autorisé les bourses électroniques, ouvrant la voie au trading haute fréquence informatisé.

Comment fonctionne le trading algorithmique ?

Le trading algorithmique utilise des logiciels spécialisés pour mettre en œuvre diverses stratégies de trading et modèles mathématiques. Ces stratégies peuvent inclure le suivi de tendance, le retour à la moyenne, le spread betting ou l'arbitrage. Les algorithmes prennent des décisions de trading sur la base d'informations électroniques avant que les traders humains ne puissent les traiter.

Quel a été l'impact du processus de décimalisation aux États-Unis sur le trading algorithmique ?

L'achèvement du processus de décimalisation aux États-Unis en 2001, qui a fait passer la taille minimale des ticks de fractions à des décimales, a entraîné des changements dans la structure du marché. Il a permis des différences plus faibles entre les cours acheteur et vendeur, ce qui a permis aux investisseurs de réagir plus facilement à l'évolution des cotations et au resserrement des spreads.

| Précédent : Trading Forex automatique | Suivant : Comment choisir un Expert Advisor |